Digitale Praxis: PDF-Dateien für die Nutzung durch LLMs aufbereiten

PDFs sind aus dem Unternehmensalltag nicht wegzudenken – doch für den Einsatz mit KI-Systemen sind sie oft schlecht geeignet. Dieser Beitrag zeigt, warum das so ist, und welche Methoden helfen, PDF-Inhalte maschinell nutzbar zu machen.

Warum sollte man PDF-Dateien aufbereiten?

Unternehmensdaten liegen in verschiedenen Formaten vor. Ein Format, das sich besonders im Alltag durchgesetzt hat, ist die PDF-Datei. Wenn diese Daten automatisiert – etwa durch ein LLM (Large Language Model) – verarbeitet werden sollen, müssen sie so vorliegen, dass eine Maschine sie zuverlässig auslesen kann.

PDF-Dateien basieren auf einem Standard, der 1992 erstmals vorgestellt wurde. Zu dieser Zeit spielte die elektronische Datenverarbeitung noch eine untergeordnete Rolle im Alltag der meisten Menschen. Das Konzept des PDFs orientierte sich am analogen Papier mit festen Dimensionen wie DIN A4 – übertragen in die digitale Welt. Da eine maschinengestützte Weiterverarbeitung kaum eine Rolle spielte, wurde im Standard nicht berücksichtigt, dass der Inhalt von Computern strukturiert wieder ausgelesen werden können sollte. Erschwerend kommt hinzu: Das Extrahieren von Text aus einem PDF ist überhaupt nur möglich, wenn der Text tatsächlich als solcher hinterlegt ist – und nicht lediglich als Bild abgespeichert wurde.

Wie sieht eine Aufbereitung in der Praxis aus?

Um den Mehrwert einer Aufbereitung zu verdeutlichen, testen wir anhand eines konkreten Beispiels verschiedene Methoden, den Inhalt einer PDF-Datei auszulesen.

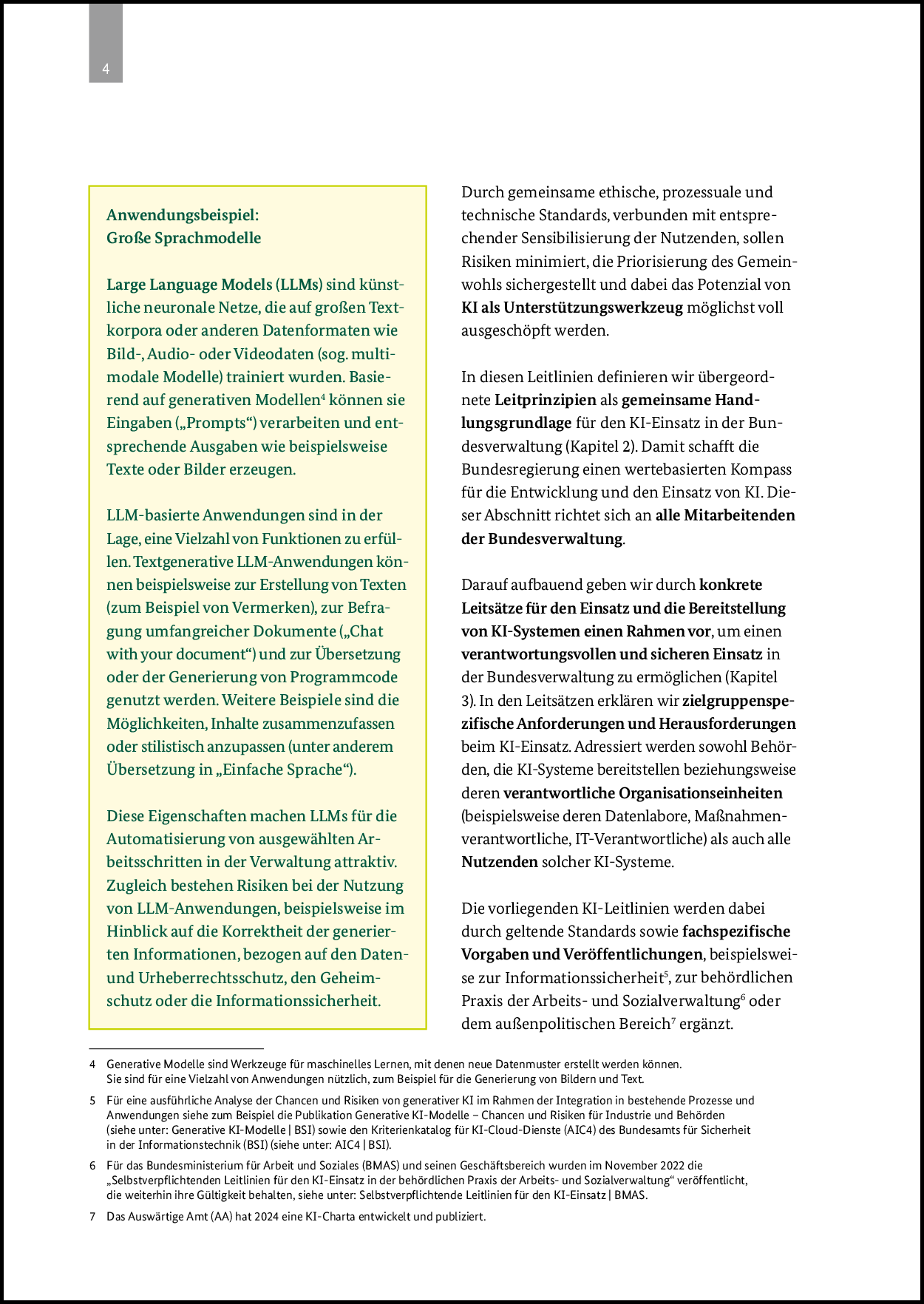

Beispiel

Als Beispiel dient eine PDF-Datei des Bundesministeriums des Innern: „Leitlinien für den Einsatz Künstlicher Intelligenz in der Bundesverwaltung“. Das Dokument enthält ein aufwändiges Layout. Für diesen Beitrag konzentrieren wir uns auf Seite 4, wie im Bild unten zu sehen.

Methode 1: Auslesen des hinterlegten Texts

Die einfachste Möglichkeit, Text aus einem PDF zu extrahieren, ist der direkte Zugriff auf den eingebetteten Text – zum Beispiel mit Python. Der folgende Code liest den im PDF hinterlegten Text seitenweise aus und speichert ihn als Textdatei:

from pathlib import Path

import fitz

def pdf_to_text(pdf_path: str | Path, out_path: str | Path) -> None:

pdf_path = Path(pdf_path)

out_path = Path(out_path)

with fitz.open(pdf_path) as doc:

parts: list[str] = []

for page in doc:

parts.append(page.get_text("text"))

text = "\n".join(parts)

out_path.write_text(text, encoding="utf-8")

pdf_to_text("./BMI25020-leitlinien-ki-bundesverwaltung_p4.pdf", "./blog-pdf-4.txt")Ergebnis:

4

Anwendungsbeispiel:

Große Sprachmodelle

Large Language Models (LLMs) sind künst-

liche neuronale Netze, die auf großen Text-

korpora oder anderen Datenformaten wie

Bild-, Audio- oder Videodaten (sog. multi-

modale Modelle) trainiert wurden. Basie-

rend auf generativen Modellen4 können sie

Eingaben („Prompts“) verarbeiten und ent-

sprechende Ausgaben wie beispielsweise

Texte oder Bilder erzeugen.

LLM-basierte Anwendungen sind in der

Lage, eine Vielzahl von Funktionen zu erfül-

len. Textgenerative LLM-Anwendungen kön-

nen beispielsweise zur Erstellung von Texten

(zum Beispiel von Vermerken), zur Befra-

gung umfangreicher Dokumente („Chat

with your document“) und zur Übersetzung

oder der Generierung von Programmcode

genutzt werden. Weitere Beispiele sind die

Möglichkeiten, Inhalte zusammenzufassen

oder stilistisch anzupassen (unter anderem

Übersetzung in „Einfache Sprache“).

Diese Eigenschaften machen LLMs für die

Automatisierung von ausgewählten Ar-

beitsschritten in der Verwaltung attraktiv.

Zugleich bestehen Risiken bei der Nutzung

von LLM-Anwendungen, beispielsweise im

Hinblick auf die Korrektheit der generier-

ten Informationen, bezogen auf den Daten-

und Urheberrechtsschutz, den Geheim-

schutz oder die Informationssicherheit.

4 Generative Modelle sind Werkzeuge für maschinelles Lernen, mit denen neue Datenmuster erstellt werden können.

Sie sind für eine Vielzahl von Anwendungen nützlich, zum Beispiel für die Generierung von Bildern und Text.

5 Für eine ausführliche Analyse der Chancen und Risiken von generativer KI im Rahmen der Integration in bestehende Prozesse und

Anwendungen siehe zum Beispiel die Publikation Generative KI-Modelle – Chancen und Risiken für Industrie und Behörden

(siehe unter: Generative KI-Modelle | BSI) sowie den Kriterienkatalog für KI-Cloud-Dienste (AIC4) des Bundesamts für Sicherheit

in der Informationstechnik (BSI) (siehe unter: AIC4 | BSI).

6 Für das Bundesministerium für Arbeit und Soziales (BMAS) und seinen Geschäftsbereich wurden im November 2022 die

„Selbstverp!ichtenden Leitlinien für den KI-Einsatz in der behördlichen Praxis der Arbeits- und Sozialverwaltung“ veröffentlicht,

die weiterhin ihre Gültigkeit behalten, siehe unter: Selbstverp!ichtende Leitlinien für den KI-Einsatz | BMAS.

7 Das Auswärtige Amt (AA) hat 2024 eine KI-Charta entwickelt und publiziert.

Durch gemeinsame ethische, prozessuale und

technische Standards, verbunden mit entspre-

chender Sensibilisierung der Nutzenden, sollen

Risiken minimiert, die Priorisierung des Gemein-

wohls sichergestellt und dabei das Potenzial von

KI als Unterstützungswerkzeug möglichst voll

ausgeschöpft werden.

In diesen Leitlinien definieren wir übergeord-

nete Leitprinzipien als gemeinsame Hand-

lungsgrundlage für den KI-Einsatz in der Bun-

desverwaltung (Kapitel 2). Damit schafft die

Bundesregierung einen wertebasierten Kompass

für die Entwicklung und den Einsatz von KI. Die-

ser Abschnitt richtet sich an alle Mitarbeitenden

der Bundesverwaltung.

Darauf aufbauend geben wir durch konkrete

Leitsätze für den Einsatz und die Bereitstellung

von KI-Systemen einen Rahmen vor, um einen

verantwortungsvollen und sicheren Einsatz in

der Bundesverwaltung zu ermöglichen (Kapitel

3). In den Leitsätzen erklären wir zielgruppenspe-

zifische Anforderungen und Herausforderungen

beim KI-Einsatz. Adressiert werden sowohl Behör-

den, die KI-Systeme bereitstellen beziehungsweise

deren verantwortliche Organisationseinheiten

(beispielsweise deren Datenlabore, Maßnahmen-

verantwortliche, IT-Verantwortliche) als auch alle

Nutzenden solcher KI-Systeme.

Die vorliegenden KI-Leitlinien werden dabei

durch geltende Standards sowie fachspezifische

Vorgaben und Veröffentlichungen, beispielswei-

se zur Informationssicherheit5, zur behördlichen

Praxis der Arbeits- und Sozialverwaltung6 oder

dem außenpolitischen Bereich7 ergänzt.

Methode 2: Nutzung eines OCR-VLM

Ein VLM (Vision Language Model) ist ein Sprachmodell, das neben Text auch Bilder verarbeiten kann. Es gibt spezialisierte VLMs, die auf OCR (Optical Character Recognition) ausgerichtet sind und teils unter Open-Source-Lizenzen frei verfügbar sind. In diesem Beispiel nutzen wir DeepSeek-OCR-2. Das Modell bietet verschiedene Modi zur Textextraktion, die über eine Textinstruktion gesteuert werden. Wir testen die Modi „document“ und „Free OCR“.

Modus „document“

<|ref|>sub_title<|/ref|><|det|>[[108, 153, 285, 189]]<|/det|>

## Anwendungsbeispiel: Große Sprachmodelle

<|ref|>text<|/ref|><|det|>[[107, 207, 442, 369]]<|/det|>

Large Language Models (LLMs) sind künstliche neuronale Netze, die auf großen Textkorpora oder anderen Datenformaten wie Bild-, Audio- oder Videodaten (sog. multimodale Modelle) trainiert wurden. Basierend auf generativen Modellen \( ^{4} \) können sie Eingaben („Prompts“) verarbeiten und entsprechende Ausgaben wie beispielsweise Texte oder Bilder erzeugen.

<|ref|>text<|/ref|><|det|>[[107, 385, 444, 600]]<|/det|>

LLM-basierte Anwendungen sind in der Lage, eine Vielzahl von Funktionen zu erfüllen. Textgenerative LLM-Anwendungen können beispielsweise zur Erstellung von Texten (zum Beispiel von Vermerken), zur Befragung umfangreicher Dokumente („Chat with your document“) und zur Übersetzung oder der Generierung von Programmcode genutzt werden. Weitere Beispiele sind die Möglichkeiten, Inhalte zusammenzufassen oder stilistisch anzupassen (unter anderem Übersetzung in „Einfache Sprache“).

<|ref|>text<|/ref|><|det|>[[107, 616, 445, 778], [492, 137, 868, 262]]<|/det|>

Diese Eigenschaften machen LLMs für die Automatisierung von ausgewählten Arbeitsschritten in der Verwaltung attraktiv. Zugleich bestehen Risiken bei der Nutzung von LLM-Anwendungen, beispielsweise im Hinblick auf die Korrektheit der generierten Informationen, bezogen auf den Daten- und Urheberrechtsschutz, den Geheimschutz oder die Informationssicherheit.

Durch gemeinsame ethische, prozessuale und technische Standards, verbunden mit entsprechender Sensibilisierung der Nutzenden, sollen Risiken minimiert, die Priorisierung des Gemeinwohls sichergestellt und dabei das Potenzial von KI als Unterstützungswerkzeug möglichst voll ausgeschöpft werden.

<|ref|>text<|/ref|><|det|>[[492, 278, 867, 422]]<|/det|>

In diesen Leitlinien definieren wir übergeordnete Leitprinzipien als gemeinsame Handlungsgrundlage für den KI-Einsatz in der Bundesverwaltung (Kapitel 2). Damit schafft die Bundesregierung einen wertebasierten Kompass für die Entwicklung und den Einsatz von KI. Dieser Abschnitt richtet sich an alle Mitarbeitenden der Bundesverwaltung.

<|ref|>text<|/ref|><|det|>[[492, 439, 868, 671]]<|/det|>

Darauf aufbauend geben wir durch konkrete Leitsätze für den Einsatz und die Bereitstellung von KI-Systemen einen Rahmen vor, um einen verantwortungsvollen und sicheren Einsatz in der Bundesverwaltung zu ermöglichen (Kapitel 3). In den Leitsätzen erklären wir zielgruppenspezifische Anforderungen und Herausforderungen beim KI-Einsatz. Adressiert werden sowohl Behörden, die KI-Systeme bereitstellen beziehungsweise deren verantwortliche Organisationseinheiten (beispielsweise deren Datenlabore, Maßnahmenverantwortliche, IT-Verantwortliche) als auch alle Nutzenden solcher KI-Systeme.

<|ref|>text<|/ref|><|det|>[[492, 688, 867, 795]]<|/det|>

Die vorliegenden KI-Leitlinien werden dabei durch geltende Standards sowie fachspezifische Vorgaben und Veröffentlichungen, beispielsweise zur Informationssicherheit \( ^{5} \) , zur behördlichen Praxis der Arbeits- und Sozialverwaltung \( ^{6} \) oder dem außenpolitischen Bereich \( ^{7} \) ergänzt.

Modus „Free OCR“

4

Anwendungsbeispiel:

Große Sprachmodelle

Large Language Models (LLMs) sind künstliche neuronale Netze, die auf großen Textkorpora oder anderen Datenformaten wie Bild-, Audio- oder Videodaten (sog. multimodale Modelle) trainiert wurden. Basierend auf generativen Modellen⁴ können sie Eingaben („Prompts“) verarbeiten und entsprechende Ausgaben wie beispielsweise Texte oder Bilder erzeugen.

LLM-basierte Anwendungen sind in der Lage, eine Vielzahl von Funktionen zu erfüllen. Textgenerative LLM-Anwendungen können beispielsweise zur Erstellung von Texten (zum Beispiel von Vermerken), zur Befragung umfangreicher Dokumente („Chat with your document“) und zur Übersetzung oder der Generierung von Programmcode genutzt werden. Weitere Beispiele sind die Möglichkeiten, Inhalte zusammenzufassen oder stilistisch anzupassen (unter anderem Übersetzung in „Einfache Sprache“).

Diese Eigenschaften machen LLMs für die Automatisierung von ausgewählten Arbeitsschritten in der Verwaltung attraktiv. Zugleich bestehen Risiken bei der Nutzung von LLM-Anwendungen, beispielsweise im Hinblick auf die Korrektheit der generierten Informationen, bezogen auf den Daten- und Urheberrechtsschutz, den Geheimschutz oder die Informationssicherheit.

Durch gemeinsame ethische, prozessuale und technische Standards, verbunden mit entsprechender Sensibilisierung der Nutzenden, sollen Risiken minimiert, die Priorisierung des Gemeinwohls sichergestellt und dabei das Potenzial von KI als Unterstützungswerkzeug möglichst voll ausgeschöpft werden.

In diesen Leitlinien definieren wir übergeordnete **Leitprinzipien** als gemeinsame Handlungsgrundlage für den KI-Einsatz in der Bundesverwaltung (Kapitel 2). Damit schafft die Bundesregierung einen weiterbasierten Kompass für die Entwicklung und den Einsatz von KI. Dieser Abschnitt richtet sich an **alle Mitarbeitenden der Bundesverwaltung**.

Darauf aufbauend geben wir durch **konkrete Leitsätze für den Einsatz und die Bereitstellung von KI-Systemen einen Rahmen vor**, um einen **verantwortungsvollen und sicheren Einsatz** in der Bundesverwaltung zu ermöglichen (Kapitel 3). In den Leitsätzen erklären wir **zielgruppenspezifische Anforderungen und Herausforderungen** beim KI-Einsatz. Adressiert werden sowohl Behörden, die KI-Systeme bereitstellen beziehungsweise deren **verantwortliche Organisationseinheiten** (beispielsweise deren Datenlabore, Maßnahmenverantwortliche, IT-Verantwortliche) als auch alle **Nutzenden solcher KI-Systeme**.

Die vorliegenden KI-Leitlinien werden dabei durch geltende Standards sowie **fachspezifische Vorgaben und Veröffentlichungen**, beispielsweise zur Informationssicherheit⁵, zur behördlichen Praxis der Arbeits- und Sozialverwaltung⁶ oder dem außenpolitischen Bereich⁷ ergänzt.

—

⁴ Generative Modelle sind Werkzeuge für maschinelles Lernen, mit denen neue Datenmuster erstellt werden können. Sie sind für eine Vielzahl von Anwendungen nützlich, zum Beispiel für die Generierung von Bildern und Text.

⁵ Für eine ausführliche Analyse der Chancen und Risiken von generativer KI im Rahmen der Integration in bestehende Prozesse und Anwendungen siehe zum Beispiel die Publikation Generative KI-Modelle – Chancen und Risiken für Industrie und Behörden (siehe unter: Generative KI-Modelle | BSI) sowie den Kriterienkatalog für KI-Cloud-Dienste (AIC4) des Bundesamts für Sicherheit in der Informationstechnik (BSI) (siehe unter: AIC4 | BSI).

⁶ Für das Bundesministerium für Arbeit und Soziales (BMAS) und seinen Geschäftsbereich wurden im November 2022 die „Selbstverpflichtenden Leitlinien für den KI-Einsatz in der behördlichen Praxis der Arbeits- und Sozialverwaltung“ veröffentlicht, die weiterhin ihre Gültigkeit behalten, siehe unter: Selbstverpflichtende Leitlinien für den KI-Einsatz | BMAS.

⁷ Das Auswärtige Amt (AA) hat 2024 eine KI-Charta entwickelt und publiziert.

Die unterschiedlichen Ergebnisse im Vergleich

Das gewählte Beispiel hat zugegebenermaßen ein komplexes Layout – aber genau das macht den Vergleich aufschlussreich.

Beim direkten Auslesen des hinterlegten Texts gerät das Layout durcheinander: Es entstehen unnötige Zeilenumbrüche mitten im Fließtext, die eine automatisierte Weiterverarbeitung erschweren. Das OCR-VLM schneidet hier deutlich besser ab: Zeilenumbrüche und per Trennstrich geteilte Wörter werden automatisch zusammengeführt und der Text strukturiert ausgegeben. Auch das OCR-VLM ist jedoch nicht fehlerfrei: Im Modus „document“ werden Fußnoten gar nicht erkannt; im Modus „Free OCR“ taucht die Kopfzeile mit Seitenzahl im Fließtext auf. Insgesamt stellt der Einsatz eines OCR-VLM aber eine deutliche Verbesserung gegenüber dem reinen Textauslesen dar.

Warum nicht einfach das PDF direkt in ein VLM laden?

Ein direktes Gespräch mit einem Dokument ist mit VLMs wie ChatGPT grundsätzlich möglich. Sobald jedoch in einem größeren Korpus von Dokumenten gesucht werden soll, stoßen diese Lösungen schnell an ihre Grenzen. Für solche Szenarien wird ein vorgelagertes System benötigt, das relevante Dokumente vorauswählt. Das zugehörige Stichwort lautet RAG – Retrieval Augmented Generation.

Alte Scans und Papierdokumente digitalisieren

In vielen Unternehmen liegen Handbücher und historische Dokumente nur als Scan oder gar nur in Papierform vor. Mit den vorgestellten OCR-VLM-Methoden lassen sich genau diese Bestände mit überschaubarem Aufwand digitalisieren und in strukturierter Form in die Datenspeicher des Unternehmens überführen – ein wertvoller erster Schritt in Richtung einer durchgängig KI-gestützten Dokumentenverarbeitung.

Fragen & Anmerkungen

Bei Fragen oder Anmerkungen freue ich mich über Ihre Nachricht. Wenn Sie ein konkretes Umsetzungsprojekt in Ihrem Unternehmen planen, sprechen Sie mich gerne an – in Kürze auch über den AI-Helpdesk im EDIH South Westphalia oder bis dahin per E-Mail unter florian.breda@uni-siegen.de.